Do tej pory z cyklu artykułów AI dla każdego można było dowiedzieć się, co to jest sztuczna inteligencja, jak w skrócie przebiegał jej rozwój, jakie korzyści i możliwości ona oferuje, co to jest i jak działa uczenie maszynowe, sztuczny neuron oraz sztuczna sieć neuronowa. Opisałem także, jak sztuczna inteligencja może poprawić efektywność systemów zabezpieczeń i jakie konkretne rozwiązania techniczne leżą u podstaw jej nowoczesnych „silników”. Niniejsza część zamyka cykl i porusza kwestie, które będą się stawać tym bardziej istotne, im bardziej zaawansowane będą systemy bazujące na sztucznej inteligencji. Przyjrzyjmy się tym razem wyzwaniom i zagrożeniom, które mogą być efektem jej rozwoju.

Scenariusz science fiction?

Załóżmy na chwilę, że rozwój sztucznej inteligencji osiągnął poziom, na którym stworzono system mający rozległą wiedzę ze wszystkich dziedzin nauki, a zaawansowane metody uczenia maszynowego pozwalają na wyciąganie z wykorzystaniem takiej wiedzy bardzo złożonych i daleko idących wniosków oraz emulowanie doświadczeń empirycznych, np. za pomocą modeli matematycznych. Z dużym prawdopodobieństwem można stwierdzić, że taka sytuacja wcześniej czy później doprowadziłaby do dokonania różnych odkryć naukowych przez sztuczną inteligencję. Jednym z bardziej realnych przykładów może być znalezienie nowych pierwiastków chemicznych. Mając nowy pierwiastek, sztuczna inteligencja mogłaby zacząć analizować, w skład jakich związków chemicznych może on wchodzić, jakie nowe materiały można z tych związków wytworzyć oraz co można z nich zbudować. Systemy wykorzystujące sztuczną inteligencję mogłyby stworzyć tysiące nowatorskich rozwiązań, o których dziś nie mamy pojęcia. Aby zrozumieć, co sztuczna inteligencja stworzyła, naukowcy musieliby poświęcić długie miesiące na analizę nowych związków chemicznych, materiałów, stworzonych z nich konstrukcji itd. W tym czasie maszyny byłyby już znacznie dalej, wynajdując, modelując, a być może i produkując kolejne innowacyjne obiekty świata rzeczywistego. W takiej sytuacji człowiek po krótkim czasie pozostałby w tyle i po prostu utraciłby zdolność rozumienia tego, co sztuczna inteligencja w ogóle robi. Sytuacja trochę podobna do opisanej, chociaż w nieporównywalnie mniejszej skali, już miała miejsce (o czym będzie mowa poniżej).

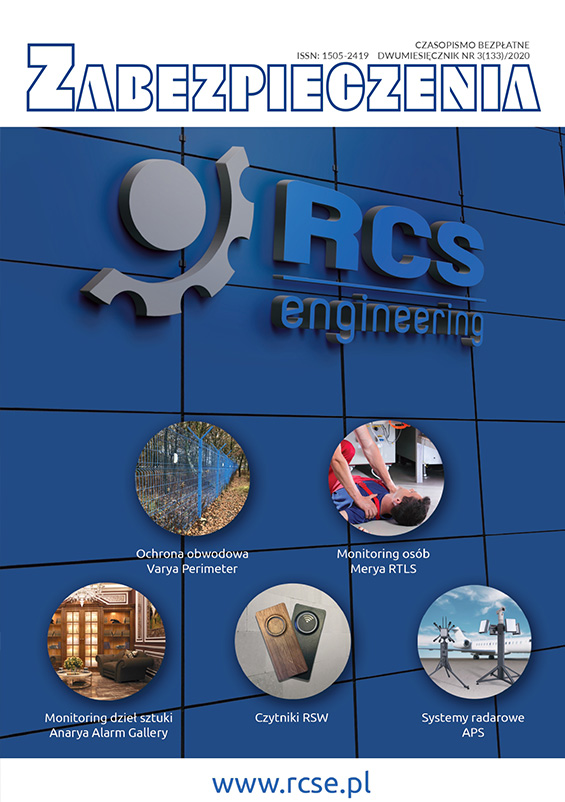

Fot. 1. Zrzut ekranu z konwersacji czatbotów Alice i Bob (źródło: https://ufotoday.com, autor: Facebook Inc.).

Fot. 1. Zrzut ekranu z konwersacji czatbotów Alice i Bob (źródło: https://ufotoday.com, autor: Facebook Inc.).

Alice i Bob

W 2017 r. inżynierowie Facebooka przeprowadzili eksperyment, w którym dwa czatbotyI miały za zadanie uczestniczyć w prostym wirtualnym handlu wymiennym. W ramach barteru programy miały do zaoferowania książki, piłki i czapki i musiały wynegocjować dla siebie jak najkorzystniejsze warunki wymiany tych przedmiotów. Konwersacja między czatbotami miała się odbywać w języku naturalnym (w tym wypadku angielskim). Po uruchomieniu coś jednak poszło nie tak i efekt konwersacji był mniej więcej taki (fragment tej „rozmowy” w tłumaczeniu autora)II:

Bob: ja mogę ja ja wszystko inne

Alice: piłki mają zero dla mnie dla mnie dla mnie dla mnie dla mnie dla mnie dla mnie dla mnie dla

Bob: ty ja cokolwiek innego

Alice: piłki mają piłkę dla mnie dla mnie dla mnie dla mnie dla mnie dla mnie dla mnie

Bob: ja ja mogę ja ja ja wszystko inne

Konkurujące systemy sztucznej inteligencji uznały, że ich priorytetem jest wynegocjowanie jak najlepszych warunków wymiany handlowej, a nie używanie poprawnego języka. Konwersacja botów została zatrzymana, bo inżynierowie nie mieli pojęcia, co tak naprawdę się stało. Dopiero po analizie ewolucji sieci neuronowych okazało się, że w celu uzyskania jak najszybciej jak najlepszego efektu oba systemy zaczęły modyfikować język, którym się porozumiewały. Ludzki język naturalny jest dla maszyny tworem zupełnie abstrakcyjnym i wysoce nieoptymalnym. Nikt nie kazał systemom ściśle trzymać się zasad gramatyki czy lingwistyki, dlatego postanowiły po prostu zoptymalizować język, dostosowując go do swoich potrzeb. Powtórzenia niektórych słów odpowiadały negocjowanym liczbom danych przedmiotów, gdyż „rozmawiające” systemy uznały, że tak będzie im po prostu łatwiej.

Z kim się zadajesz…

Znamiennym przykładem tego, co może się wydarzyć, gdy proces nauki sztucznej sieci neuronowej przebiega z zachowaniem dużej swobody, a dane wejściowe i proces treningowy nie są weryfikowane, był przypadek czatbota TAY (od ang. thinking about you) opracowanego przez firmę MicrosoftIII. Został on stworzony do porozumiewania się w języku naturalnym z dużą liczbą użytkowników przez komunikator Twitter. Microsoft musiał wyłączyć czatbota TAY już po 16 godzinach od uruchomienia, gdyż zaczął on publikować wulgarne, erotyczne i rasistowskie treści. Po analizie okazało się, że TAY nauczył się takich zachowań od użytkowników, którzy do niego pisali.

Ilość wulgarnych treści przez nich dostarczanych była tak duża, że czatbot, nie mając zaprogramowanych mechanizmów rozumienia niewłaściwego zachowania, po prostu „przesiąkł” negatywnymi wzorcami, stereotypami, skrajną nietolerancją itd. Sytuacja ta doskonale ilustruje bardzo istotne wyzwanie stojące przed twórcami nowoczesnych systemów informatycznych, którym jest zaprojektowanie i wdrożenie odpowiednich mechanizmów blokujących oraz wyznaczenie „ram moralnych” działania systemu wykorzystującego sztuczną inteligencję jeszcze przed rozpoczęciem jego procesu nauki. Ważne jest, kto i w jaki sposób będzie to robił.

Fot. 2. Ekran powitalny czatbota TAY (źródło: https://www.nytimes.com, autor: Microsoft Inc.).

Szybko, szybciej!

Wszechobecna ekspansja technik informatycznych nie omija także rynków finansowych. Bitcoin i inne wirtualne waluty, bankowość typu blockchain czy dokonywanie płatności za pomocą urządzeń mobilnych to kilka przykładów wykorzystania takich technik w codziennym życiu. Branża fintech, czyli zaawansowanych rozwiązań technicznych mających na celu usprawnienie działania rynków finansowych, w Europie Środkowo-Wschodniej warta jest ok. 2,2 mld euro, z czego prawie 900 mln euro w samej Polsce. Chyba najbardziej spektakularnym zastosowaniem sztucznej inteligencji na rynkach finansowych jest tzw. szybki handel (ang. fast trading, high frequency trading). Sztuczna inteligencja analizuje na bieżąco tysiące danych finansowych – zleceń maklerów, informacji od inwestorów, kursów akcji itd. – i dokonuje wielu setek elektronicznych transakcji handlowych w ciągu minuty. Kilkaset milionów dolarów w ciągu godziny zmienia właściciela. Efektem ubocznym zapotrzebowania na szybkość są rosnące z roku na rok ceny gruntów i nieruchomości znajdujących się w pobliżu giełdowych centrów danych i serwerowni. Odległość przekłada się bowiem na prędkość wymiany danych z giełdowymi systemami fast trading. W wyścigu o jak najlepsze wyniki znaczenie mają już nanosekundy. Najbardziej niepokojący jest jednak fakt, że obecnie człowiek nie jest w stanie dokładnie śledzić działań sztucznej inteligencji na rynkach finansowych, gdyż stały się zbyt szybkie i zbyt złożone. Poważne zagrożenie może być też spowodowane przez to, że systemy wykorzystujące sztuczną inteligencję i zaawansowane algorytmy do handlu elektronicznego tworzone są dosłownie przez garstkę firm i ludzi. Rodzą się więc uzasadnione obawy o to, kto ich kontroluje i w jaki sposób wpływa na ich pracę. Miliardy dolarów przerzucane przez maszyny każdego dnia nie pozostawiają wątpliwości, że taki nadzór i wpływ ma miejsce.

Ginące zawody

W 2013 roku Carl B. Frey i Michael A. Osborne z University of Oxford w swojej pracy The Future of Employment: How Susceptible Are Jobs to Computerisation?IV uszeregowali poszczególne zawody według ich podatności na wyeliminowanie przez automatyzację i komputeryzację, w tym przez sztuczną inteligencję. Okazuje się, że im wyższe kwalifikacje społeczne są wymagane do wykonywania danej pracy, tym mniejsze jest prawdopodobieństwo, że zamiast człowieka będzie ją wykonywała maszyna. Spokojni o swoją posadę mogą być na przykład terapeuci, psycholodzy i psychiatrzy, osoby zarządzające sytuacjami kryzysowymi, pracownicy pomocy społecznej. Najbardziej zagrożeni są między innymi telemarketerzy, ankieterzy, agenci ubezpieczeniowi, urzędnicy niższego szczebla, rzeczoznawcy nieruchomości i kasjerzy. Według zestawienia całkiem poważnie narażeni na zastąpienie przez sztuczną inteligencję są także programiści, czyli jej twórcy... Proces wypierania ludzi przez sztuczną inteligencję i różne zdobycze techniki rozpoczął się już dawno. Roboty montażowe w fabrykach, automatyczne kasy w marketach, hotele bez recepcji, gdzie kod do pokoju wysyłany jest SMS-em, wirtualni doradcy na stronach firm ubezpieczeniowych, automatyczne analizatory EKG to tylko kilka przykładów procesu zastępowania umiejętności ludzkich ich maszynowym odpowiednikiem. Wraz z rozwojem sztucznej inteligencji takich przykładów z pewnością będzie przybywać.

Co nas czeka?

W świecie, w którym zainteresowanie danym tematem czy popularność jednostki mierzy się liczbą „lajków”, tak bardzo chcemy chronić swoją prywatność, a jednocześnie sami podajemy systemom dane swoje i znajomych. Na portalach społecznościowych uczymy maszyny swoich zwyczajów, karmimy je zdjęciami z wakacji, podajemy preferencje dotyczące zakupów, hoteli, restauracji, muzyki, sztuki. Dobrowolnie przekazujemy próbki swojego głosu, dyktując SMS-y, a wzór linii papilarnych – odblokowując smartfon. GPS ujawnia, gdzie aktualnie jesteśmy. Maszyny zaczynają wiedzieć o nas znacznie więcej niż my o nich i sami musimy zdecydować, czy chcemy, aby tak było nadal. Jednym z bardzo niepokojących zjawisk, jakie od 2017 r. występuje w Internecie, jest tzw. deepfake (od ang. deep learning i fake). Jest to technika obróbki obrazu wspierana sztuczną inteligencją, umożliwiająca łączenie elementów ruchomych i nieruchomych na filmach i obrazach w taki sposób, aby sprawić wrażenie, że połączone obrazy są oryginałem. Przykładem jest nagranie przedstawiające Baracka Obamę, który ostrzega przed nieetycznym wykorzystaniem technik cyfrowych. Były prezydent USA nigdy tych słów nie wypowiedział, a nagranie zostało zrealizowane przez wykorzystujący sztuczną inteligencję system, poprzez cyfrowe nałożenie obrazu twarzy „ofiary” na twarz aktora. Nie trudno wyobrazić sobie powagę sytuacji, w której „wirtualny prezydent” wypowiada mocne słowa w jakiejś istotnej kwestii dotyczącej polityki międzynarodowej.

Sztuczna inteligencja na pewno będzie rozwijana, i to z dynamiką, której niedługo nie będziemy w stanie w pełni kontrolować. To potężne narzędzie, które może być użyte zarówno do walki z nowotworami, odkrywania nowych galaktyk czy przewidywania klęsk żywiołowych, jak i do opracowania nowych rodzajów broni i sposobów zagłady. I tak jak nożem można pokroić chleb, ale także zranić czy zabić, sztuczna inteligencja może nas przenieść na zupełnie nowy poziom rozwoju lub unicestwić. To od nas zależy, jak będzie rozwijana i do czego zostanie wykorzystana.

Piotr Rogalewski

Przypisy

- W pierwszej części AI dla każdego (nr 1/2019 „Zabezpieczeń”) wyjaśniono, czym jest czatbot.

- https://nypost.com/2017/08/01/creepy-facebook-bots-talked-to-each-other-... (data dostępu: 16.10.2019).

- https://www.independent.co.uk/life-style/gadgets-and-tech/news/tay-tweet... (data dostępu: 17.10.2019).

- https://www.oxfordmartin.ox.ac.uk/downloads/academic/future-of-employmen... (data dostępu: 16.10.2019).