O ile (zgodnie z zaprezentowaną w wstępie do części I cyklu analizą funkcjonalną - AF), możemy powiedzieć, że po przedstawionej potrzebie ochrony informacji (etap 1. AF) oraz zrozumiałej dla menedżerów konieczności realizacji tego zadania w danych warunkach (etap 2. AF) już mamy pewien pogląd na problem ochrony informacji, o tyle dla pełnego rozwinięcia zapisu tego zjawiska w całej jego złożoności brak nam identyfikacji funkcji tej ochrony, jej celowość bowiem jest w środowisku biznesowym przez większość menedżerów (intuicyjnie) w pełni rozumiana.

1. Wstęp

Spróbujmy zatem w ramach szerokiej analizy systemowej odpowiedzieć na pytanie, jakie są funkcje i cele końcowe (etap 3. AF) ochrony informacji, tylko na tej podstawie bowiem możemy „dopracować się" kilku dobrych idei (etap 5. AF), dających nam szansę na wybór teoretycznie quasi-optymalnego rozwiązania i jego wdrożenie w naszej firmie/korporacji/organizacji.

Dlaczego „quasi", a nie „rzeczywistego", czyli optymalnego w pełni? Dlatego, że zawsze i wszędzie tam, gdzie decyduje reguła obcinania kosztów, mamy sytuacje, w których pomija się sygnalne zagrożenia dotyczące istoty sprawy lub się ich nie docenia - a to już wyklucza istnienie tego rzeczywistego optimum. Mamy więc rozwiązanie optymalne, ale wyłącznie dla założonych (wprowadzonych i mniej lub bardziej świadomie określonych) ograniczających pełne widzenie problemu, warunków brzegowych. Nagminne jest bowiem ocenianie posiadanych zasobów wyłącznie od strony właścicielskiej i użytkowej pod względem biznesowym i operacyjnym. Bardzo często zaniedbuje się obowiązek archiwizacji i utylizacji już wykorzystanego zasobu. Nad wyraz rzadko analizuje się podjęte działania ochronne od strony potencjalnego intruza - przeciwnika, pragnącego dobrać się do naszych chronionych zasobów informacyjnych.

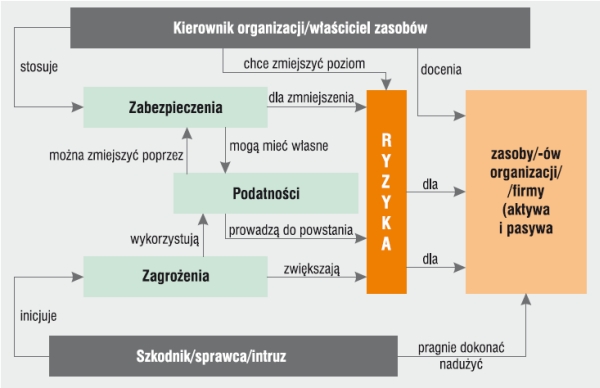

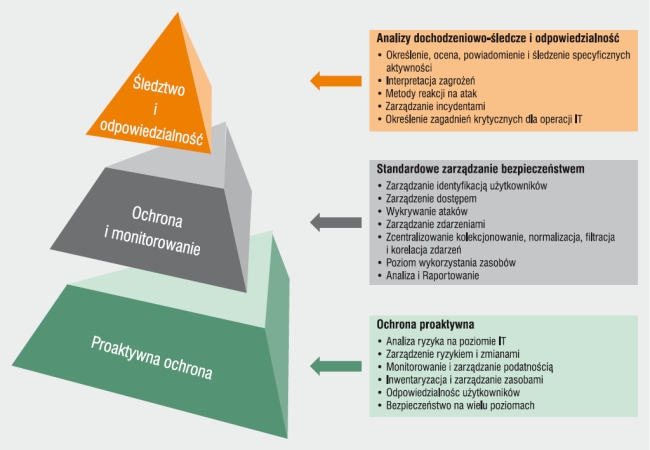

Spróbujmy zatem przyjrzeć się tym zjawiskom nieco bliżej. (Rys. 1.).

2. Informacja jako wartość

Kiedy mówimy „informacja", zazwyczaj zakładamy, że nasz rozmówca rozumie przez to pojęcie to samo co my. Ale czy tak jest naprawdę...?

Sięgnijmy zatem do pojęć zdefiniowanych i ujętych w sposób normatywny:

1. Informacja (w teorii informacji).

Wiedza redukująca lub usuwająca niepewność, dotycząca określonego zdarzenia z danego zbioru zdarzeń możliwych.

- PN-ISO/IEC 2382-16:2000

- 16.01.03 (wg stanu na 31.12.20051)

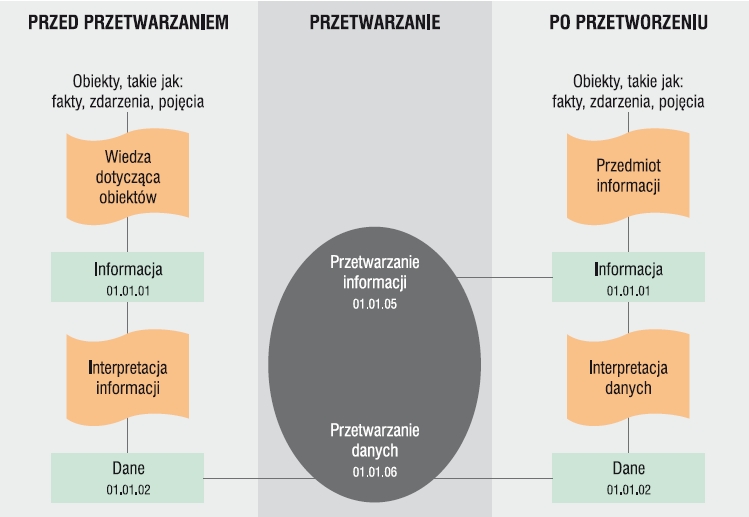

2. Informacja (przetwarzanie informacji).

Wiedza dotycząca obiektów, takich jak fakty, pojęcia, przedmioty, zdarzenia i idee.

- PN-ISO 1087-2:2001 - 2.1 (wg stanu na 31.12.20051)

3. Informacja (w przetwarzaniu informacji).

Wiedza dotycząca obiektów, takich jak fakty, zdarzenia, przedmioty, procesy lub idee, zawierająca koncepcję, która w ustalonym kontekście ma określone znaczenie.

- PN-ISO/IEC 2382-1:1996 - 01.01.01;

- PN-N-01602:1997 - 2.71 (wg stanu na 31.12.20051).

Kwestię normatywnie określonej relacji między informacją a danymi w procesie przetwarzania obrazuje rys. 2.

Łącznie w przywołanej publikacji terminologicznej1 (s. 95-99) mamy udostępnione 38 definicji zaczynających się od słowa „informacja..." wraz ze wskazanymi, jednoznacznie je określającymi, odpowiednimi normami.

W praktyce biznesowej posiłkujemy się uogólnieniami, widzianymi w podstawowym łańcuchu skojarzeń, i są to:

- informacja, jako wiedza dotycząca faktów (obiektów analizy informacyjnej);

- dane, jako prezentacja informacji dowiązanej do faktu (często w postaci już zinterpretowanej na potrzeby danego biznesu - zob.: pakiet informacyjny);

- pakiet informacyjny, jako jednostkowe uporządkowane dane przedstawione w ujednoliconej postaci na nośniku informacyjnym (trwałym - hard copy2 lub OEM3 ew. ulotnym - transmisja z wykorzystaniem ICT4);

- zbiór - baza danych, jako połączenie informacji i danych zapisanych i dostępnych wg znanych i określonych jednoznacznie korelacji (np. MS ACCESS jako baza relacyjna itp.);

- baza wiedzy (jawnej i ukrytej), jako połączenie informacji i danych o określonych wcześniej atrybutach, możliwych do wyszukiwania i łączenia z wykorzystaniem predykatów i rachunku skojarzeń (np. baza ekspercka z danej dziedziny itd.).

Nie zawsze są one jednakowo interpretowane przez poszczególnych użytkowników - menedżerów biznesowych. Chcąc ujednolicić zrozumienie (choćby hasłowe) pojęcia informacja, spróbujmy odnieść się do niego „z zewnątrz" poprzez identyfikację jego podstawowych atrybutów, tylko wtedy możemy nie tylko dokończyć opis informacji, ale również prowadzić wszelkie dalsze, niezbędne dla kolejnych przemyśleń teoretycznych i praktycznych - analizy formalne i skojarzeniowe.

2.1 Atrybuty informacji

Przeglądając dokumenty ustawowe (OIN, ODO), normy (PN, EN, ISO/IEC), standardy sojusznicze (STANAG's; AP's) oraz zalecenia biznesowe (OECD) i stowarzyszeniowe (ISACA) związane z ochroną informacji, spotykamy się z wyszczególnieniem od kilku do kilkunastu atrybutów przypisanych hasłu informacja, zależnie od wskazanego (określonego w danym dokumencie) przewidywanego środowiska funkcjonowania ochrony tych atrybutów.

Charakterystyczne dla opisu informacji są przede wszystkim (powtarzające się) trzy z nich (PID/CIA):

- poufność (ang. Confidentiality),

- integralność (ang. Integrity),

- dostępność (ang. Availability)

oraz występujące w ponad połowie analizowanych dokumentów (prawie identycznie identyfikowane i opisywane) kolejne cztery atrybuty (RANN/AAUR):

- rozliczalność (ang. Accountability),

- autentyczność (ang. Autenticity),

- niezaprzeczalność (ang. Undeniability, Unquestionability),

- niezawodność (ang. Reliability),

przy czym te ostatnie odnoszone są nie tylko do samej informacji, ale wykorzystywane są również jako atrybuty zbiorów danych oraz sprzętu i oprogramowania w systemach informacyjnych i informatycznych.

W każdym przypadku ocena bezpieczeństwa informacji oparta jest na możliwości zapewnienia, osiągnięcia i utrzymania na założonym poziomie wszystkich jej zdefiniowanych atrybutów (niezwykle istotne jest w tym przypadku odniesienie się do zdarzeń incydentalnych zagrażających samej informacji - co identyfikuje szerzej protokół ISO/IEC TR 18044 Security Incident Management).

Podstawowym dokumentem opisowym zarządzania bezpieczeństwem informacji jest międzynarodowa norma ISO/IEC 27002:2007, tożsama tekstowo z drugą edycją normy ISO/IEC 17799:2005 (opracowana w KT 182 PKN, jest dostępna w języku polskim jako PN-ISO/IEC 17799:2007), jej część definicyjna zawiera zapisy ujednolicone z ISO/IEC 13335-1:2004 (2. ed.) oraz z ISO/IEC Guide 73:2002, których treść została odpowiednio przeniesiona do specyfikacji wymagań dla systemu zarządzania bezpieczeństwem informacji - normy ISO/IEC 27001:2005 (polska edycja PN-ISO/ /IEC 27001:2007).

Zarządzanie bezpieczeństwem informacji jest możliwe wyłącznie w określonym i ograniczonym obszarze objętym systemem informacyjnym obejmującym informacje, nośniki, urządzenia i użytkowników informacji.

Prawidłowo skonstruowany system informacyjny powinien bez względu na postać (bezpośrednia/zapis na nośniku) i charakter informacji (jawna, chroniona/niejawna) spełniać trzy podstawowe kryteria:

I. Zapewniać bezpieczeństwo informacji.

II. Zapewniać bezpieczeństwo świadczenia usług.

III. Zapewniać autentyczność i rozliczalność danych i podmiotów.

Każde z przedstawionych powyżej kryteriów można i trzeba scharakteryzować:

I. Kryterium I składa się z głównych elementów:

- poufność informacji (ang. Information Confidentiality)

- co oznacza, że informacje są dostępne tylko i wyłącznie dla osób, które są do tego uprawnione;

- nienaruszalność/integralność informacji (ang. Information Integrity) - co oznacza zagwarantowanie dokładności i kompletności informacji oraz metod i sposobów ich przetwarzania;

- dostępność informacji (ang. Information Availability)

- co oznacza zapewnienie, że upoważnieni (autoryzowani) użytkownicy mają dostęp do informacji i związanych z nimi zasobów zawsze wtedy, gdy jest to wymagane.

II. Kryterium II - składa się z głównych elementów:

- niezawodność systemu (ang. System Reliability) - co oznacza, że na systemie można polegać bezwzględnie, jest on przyjazny i odporny na błędy przypadkowe operatora (fool proof);

- nienaruszalność/integralność systemu (ang. System Integrity) - co oznacza dokładność systemu oraz użytych w nim metod i sposobów przetwarzania informacji;

- dostępność systemu (ang. System Availability) - co oznacza zapewnienie, że upoważnieni (autoryzowani) użytkownicy mają gwarantowany dostęp do systemu oraz jego zasobów.

III. Kryterium III - składa się z głównych elementów:

- autentyczność danych (ang. Data Indisputable) - co oznacza, że dane przechowywane w systemie i udostępniane są pewne i można na nich polegać;

- autentyczność podmiotów (ang. Indisputable of Subjects) - co oznacza dokładność identyfikacji podmiotu korzystającego z systemu oraz potwierdzenie uprawnień do użytkowania zgromadzonych w nim informacji;

- rozliczalność podmiotów (ang. Settlement Accounts of Subjects) - co oznacza zapewnienie, że upoważnieni (autoryzowani) użytkownicy nie mają możliwości zanegowania faktu swego dostępu do systemu i udokumentowanego korzystania jego zasobów;

Dopiero dla systemu informacyjnego tak skonstruowanego, aby poprzez posiadanie i określenie każdego z elementów spełniał ww. kryteria, możemy przystąpić, w kolejnych krokach, wykorzystując dorobek i doświadczenie z praktyki stosowania zasad kodeksowych brytyjskiej, a obecnie już międzynarodowej normy (rys. 7 w cz. 1. artykułu - Zabezpieczenia 3/2007), do kolejnych czynności normatywnych związanych z SZBI/ISMS, czyli do:

- analizy zagrożeń oraz oceny stopnia i poziomu występujących dla informacji ryzyk;

- konstruowania polityki bezpieczeństwa informacji stanowiącej wykładnię zasad zarządzania informacją w tym systemie;

- wdrażania metod i sposobów niwelujących podatności na przewidywane oraz prawdopodobne zagrożenia zarówno samej informacji, jak i nośników ją zawierających.

2.2 Podatności informacji i jej nośników

W trakcie dalszych prac analitycznych wypada odpowiedzieć na (skądinąd) zasadnicze pytania: Co, jak, kiedy i na ile zagraża analizowanej przez nas informacji, oraz jak wygląda jej podatność na skutki zmaterializowania się tych przewidywanych czy też rzeczywistych zagrożeń.

W procesie ochrony informacji o wszystkich tych zjawiskach mówimy w dwóch współzależnych obszarach:

- jako podatnościach w odniesieniu do tzw. surowej postaci informacji;

- jako celowych zagrożeniach (niebezpieczeństwach) dla każdej postaci informacji, w tym także skojarzonej bezpośrednio z jej nośnikiem (papier, CD, pen drive itp.).

2.2.1 Co rozumiemy przez podatności surowej postaci informacji

Na ogół wszelkie zaburzenia i zmiany zachodzące w przekazie informacyjnym (lub w tzw. przekazie mimowolnym), do których zaliczamy:

- zwykłą postać ulotną informacji (np.: tekst rozmowy bezpośredniej lub telefonicznej/radiowej niezapisany w żadnej dostępnej formie na dowolnym nośniku trwałym) przekazywaną w układzie „nadawca" - „bezpośredni odbiorca", która jest podatna na zakłócenia przypadkowe lub celowe bez możliwości odtworzenia treści pierwotnej informacji [bardzo często odbiorca mimowolnie uzupełnia braki wynikłe w trakcie przekazu (w sposób dla niego naturalny) i „da się pokroić na plasterki", że to właśnie taką informację w tej rozmowie usłyszał oraz zapamiętał (trudno tu mówić o złej woli czy też celowej konfabulacji)];

- niechronioną postać ulotną informacji w systemach informacyjnych lub informatycznych (bardzo podatną na przypadkowe lub celowe zniekształcenia) przekazywaną w układzie „nadawca" - „punkt składowania informacji odbiorcy/adresata przekazywanej informacji", która jest podatna na zakłócenia przypadkowe lub celowe pozorujące formę treści pierwotnej informacji oraz ułatwia manipulację (opóźnienie, modyfikowanie, okresowe zagubienie lub wręcz zniszczenie);

- przypadkową generację (czytelną dla osób postronnych) części lub całości informacji w okolicznościach nieformalnych lub celowo sprowokowanych w odniesieniu do właściciela informacji lub jej czasowego posiadacza.

2.2.2 Co rozumiemy przez podatności nośników informacji

Głównie brak nadzoru nad samymi nośnikami (łatwy dostęp nieupoważnionych osób trzecich do treści zapisu) oraz niedostateczne zabezpieczenia nośników i urządzeń przechowujących informacje (możliwość kopiowania całości nośników oraz ich treści bez pozostawienia śladów).

Specyficzną podatnością jest n-krotność rozpowszechnianej informacji pozwalająca na jej cząstkowe lub całościowe odtworzenie w trybie analizy mozaikowej danych podstawowych.

3. Niebezpieczeństwa grożące „informacji"

Ujęcie w cudzysłów wyrazu informacja wiąże się z jego szerokim, popularnym i pozadefinicyjnym rozumieniem, jako „pojęcia - worka", w którym to każdy z dyskutantów znajdzie coś dla siebie, co będzie pasowało do wygłaszanych przezeń opinii.

Teoria ochrony informacji proponuje posiłkowanie się w tym przypadku określeniem system informacyjny z jego zasobem informacyjnym (czyli system, w którym możemy odnaleźć wszystkie elementy łańcucha skojarzeniowego związanego z ogólną definicją pojęcia informacja - wszystkie, bo wiemy że nie da się połączyć w całość brakujących ogniw).

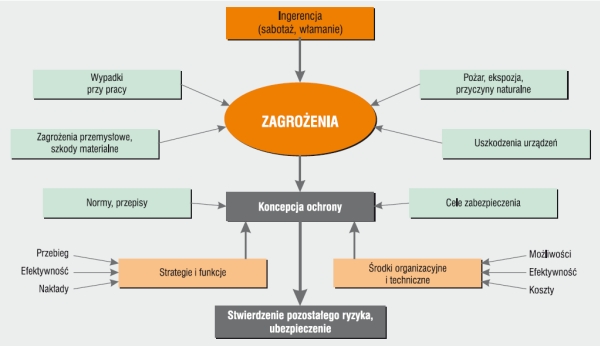

Dla tak ogólnie rozumianego „zasobu/ów" firmy (rys. 1., cz. II) można próbować opracować koncepcję ochrony, choć jest to zadanie trudne, bo większość menedżerów procesów biznesowych postrzega zagrożenia dla tych zasobów wyłącznie jako sabotaż i ingerencję z zewnątrz firmy. A jak o tym wypowiada się ogólna teoria ochrony? (rys. 3.)

Niezbyt często można spotkać się z tak szerokim i analitycznym podejściem do tej kwestii, jakże istotnej dla całościowego analizowania problemu ochrony informacji.

Patrzenie przez pryzmat działań biznesowych nie zawsze poszerza optykę widzenia zasadniczego problemu opisywanego w niniejszym artykule. Ponadto w praktyce ochrony informacji nad wyraz często spotkać się można z oczekiwaniami i żądaniami menedżerów biznesu (skierowanymi pod adresem konsultantów i audytorów) zamykającymi się w haśle „Zróbcie mi to PBI (politykę bezpieczeństwa informacji), bo nie będę (nie chcę być) gorszy od innych".

Ma się to niestety nijak do teorii zjawiska - bo co prawda są zdefiniowane podstawowe uniwersalne zasady polityki bezpieczeństwa pasujące do każdej firmy, ale... aby stworzyć łańcuch bezpieczeństwa i zamknąć w nim obszar chroniony, musimy wiedzieć:

- co chronimy, czyli jakie są zasoby i struktura chronionego systemu informacyjnego;

- przed czym chronimy, czyli jakie są zagrożenia, oraz jaki model jest odpowiedni do oceny ryzyka dla naszego systemu informacyjnego oraz objętego nim (generowanego, przetwarzanego, udostępnianego, archiwizowanego i ramach niego utylizowanego) zasobu informacji.

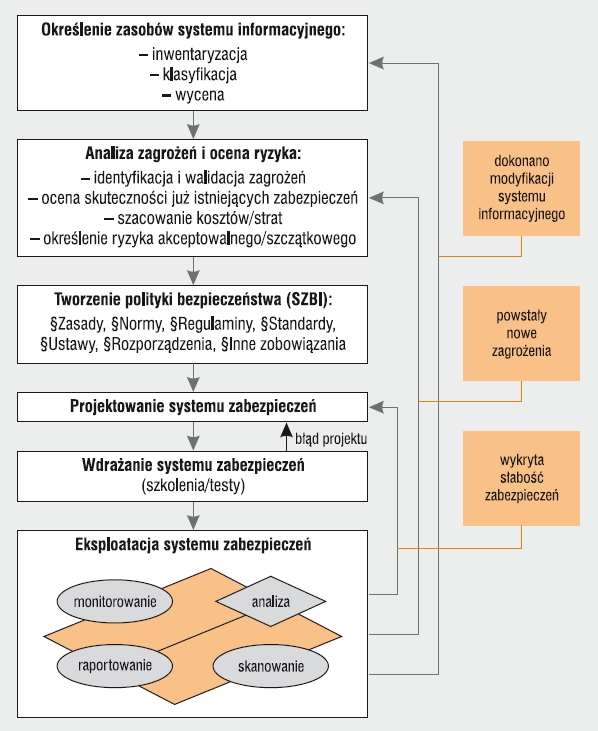

3.1 Metody projektowania zabezpieczeń dla systemu informacyjnego z jego zasobem

Metody te wynikają bezpośrednio z analizy systemowej (rys. 4., cz. I) oraz wymagań ochrony (rys. 6., cz. I), a u ich podstaw leży jedna zasadnicza myśl - nawet najlepsze systemy zabezpieczeń mają swój ograniczony technicznie i technologicznie cykl życia, ponadto przygotowane i uruchomione przez specjalistów, muszą być nadzorowane przez użytkownika we wszystkich aspektach ich późniejszego działania. To w trakcie prawidłowej eksploatacji (analiza stanu

- skanowanie - raportowanie - monitorowanie zmian - analiza stanu) wykrywamy słabości zabezpieczeń oraz identyfikujemy nowe zagrożenia. Ponadto niezbędne jest uwzględnianie wszelkich modyfikacji wprowadzanych w samym chronionym systemie.

Podstawę do kwalifikowania przydatności użytej metody stanowią ujęte w cykl:

- określenie zasobów;

- analiza zagrożeń i ocena ryzyka;

- przyjęta polityka bezpieczeństwa informacji;

- sposób jej wdrożenia;

- łatwość i skuteczność eksploatowania wdrożonych zabezpieczeń, co przedstawia rys. 4.

3.2. Zasady projektowania zabezpieczeń dla systemu informacyjnego z jego zasobem

Podstawę projektowania zabezpieczeń stanowi odwzorowanie zasobów systemu informacyjnego, zwane bardzo często mapą zasobów i wartości.

Stworzenie samej mapy zasobów wymaga:

- ustalenia grup i kategorii użytkowników poszczególnych informacji - pakietów informacyjnych - zbiorów itd., przy zachowaniu odpowiedniego oszacowania i znaczenia ich funkcjonowania dla działalności firmy;

- ustalenia zadań realizowanych przez system informacyjny (jego podsystemy w układzie wagowym i hierarchicznym) dla działalności firmy;

- ustalenia zasobów (informacyjnych, fizycznych, technicznych, osobowych) i ich wykorzystania w korelacji do grup i zadań systemu informacyjnego.

Oszacowanie wartości zasobów wymaga:

- w odniesieniu do informacji - ocenienia skutków (kosztów) ich ujawnienia, niepożądanej modyfikacji, niedostępności lub wręcz zniszczenia;

- w odniesieniu do zasobów fizycznych i technicznych będą to przypuszczalne koszty naprawy lub wymiany elementów albo całych urządzeń;

- w odniesieniu do zasobów osobowych będą to koszty zaburzeń organizacyjnych lub szacunkowe koszty utraty image'u firmy i pozycji na rynku.

Do kosztów dolicza się szacunki i wyceny związane z samym systemem zabezpieczeń (obliczone względem założonego poziomu szczelności, niezawodności i wydajności) przy uwzględnieniu posiadanej i przewidywanej do nabycia technologii wraz z kosztami jej implementacji (szkolenia, nakład pracy na wdrożenie i eksploatację). Prezentowane podejście wynika z zasad sporządzania bilansu rocznego (identyfikowalne aktywa i pasywa firmy).

W niektórych starszych opracowaniach z zakresu securitologii oraz zarządzania bezpieczeństwem (do roku 1999) można spotkać się z określeniem „wymagania funkcjonalno-techniczne zabezpieczeń", które jest tożsame z wyżej przedstawionymi.

Wówczas obowiązywały i obecnie obowiązują uniwersalne zasady ochronne, zwane aktualnie zasadami PBI systemu informacyjnego, a stanowiące w swojej treści „podstawę" postępowania w obszarze chronionym:

1. Zasada przywilejów koniecznych - każdy użytkownik systemu informacyjnego i jego zasobu posiada prawa ograniczone wyłącznie do tych, które są niezbędne i konieczne do wykonywania powierzonych mu zadań.

2. Zasada usług koniecznych - zakres dostępnych usług w ramach systemu jest ograniczony tylko do tych, które są konieczne do prawidłowego funkcjonowania firmy.

3. Zasada ubezpieczania zabezpieczeń -konieczne jest stosowanie wielowarstwowych zabezpieczeń, które ubezpieczają się wzajemnie (tzw. krotność przekrycia).

4. Zasada odpowiedzialności - za utrzymywanie właściwego poziomu bezpieczeństwa poszczególnych elementów systemu informacyjnego i jego zasobu odpowiadają konkretne osoby, które mają świadomość tego, za co są odpowiedzialne i jakie konsekwencje poniosą, jeżeli zaniedbają swoje obowiązki.

5. Zasada świadomości - wszyscy użytkownicy systemu informacyjnego wraz z jego zasobem są świadomi konieczności ochrony systemu i wykorzystywanych zasobów. Bezpieczeństwo systemu zależy w dużej mierze od bezpośredniego świadomego zaangażowania każdego pracownika organizacji.

6. Zasada najsłabszego ogniwa - poziom bezpieczeństwa systemu informacyjnego wyznacza najsłabszy (najmniej zabezpieczony) element tego systemu.

W tym ostatnim przypadku należy pamiętać, że ochrona wartościowych zasobów systemu nie może się opierać wyłącznie na jednym mechanizmie zabezpieczenia, nawet jeżeli zastosowano metody, techniki i technologie wysoce zaawansowane i o bardzo wysokim stopniu niezawodności, przypadkowa awaria bowiem pozostawia system bez ochrony.

Projektowany system zabezpieczeń musi zatem uwzględniać wszystkie ww. uwagi i zasady.

3.3. Zasady postępowania przy analizie ryzyka dla systemu informacyjnego

Przeprowadzenie analizy ryzyka dla systemu informacyjnego wiąże się z koniecznością wyeliminowania wielu stereotypowych odniesień biznesowych, na ogół pomijających uwarunkowania kryzysowe i nadzwyczajne wynikające z obowiązującego ustawodawstwa polskiego. Dodatkowo należy zwrócić uwagę na elementy planowania ciągłości działania i odtwarzania po awarii (BCP/DRP - od ang.: Business Continuity Plan/Disaster Recovery Planing) oraz zarządzanie ciągłością działania (BCM - od ang.: Business Continuity Management) w rozległych strukturach systemów informacyjnych.

Podstawę do analizy stanowią rozwiązania modelowe (w tym ujęte w normach, rozwiązaniach resortowych i stowarzyszeniowych) ze szczególnym wskazaniem na wieloletnie doświadczenia sektora bankowego.

Chcąc mówić o zarządzaniu ryzykiem, należy zdawać sobie sprawę z dwu odrębnych ciągów:

- ciągu zdarzeń (incydent-zakłócenie-zagrożenie-ryzyko-materializacja ryzyka-koszty);

- ciągu procesów informacyjnych towarzyszących ww. zdarzeniom.

Rozwiązania normatywne (ISO 27001:2005) wręcz wymagają ustanowienia planów postępowania z ryzykiem stosownie do efektów jego analizy i oceny (akceptowalne lub nie do zaakceptowania; dopuszczalne lub niedopuszczalne; pomijane lub usuwane poza zakres działań firmy).

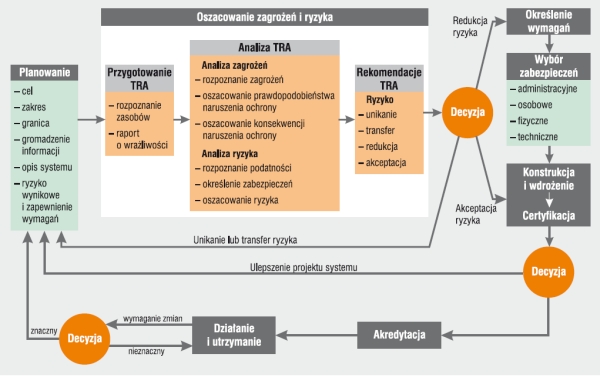

Warto zatem przywołać dobre praktyki z sektora bankowego, gdyż jest on miejscem ponoszenia skalkulowanego (i zarazem eliminowania zbędnego) ryzyka operacyjnego funkcjonowania na rynku usług i informacji finansowych. To właśnie w ramach protokołów normatywnych (ISO TR 13569 Guidelines for the Management of IT Security) opracowano model zarządzania ryzykiem na potrzeby systemów bankowych, przedstawiony na rys. 5.

Bank jest bowiem miejscem stałego i konsekwentnego analizowania każdej z wielu postaci ryzyka, do którego zalicza się:

a) ryzyko technologiczne i techniczne - związane ze stosowaniem nieadekwatnej, zawodnej lub źle wdrożonej technologii lub nieodpowiednim działaniem systemów biurowych i teleinformatycznych, adekwatnością sprzętu (hardware) i oprogramowania (software) do rodzaju i skali prowadzonej działalności, działaniem urządzeń telekomunikacyjnych, dostawami kluczowych usług (w tym telekomunikacja, energia elektryczna ze źródeł podstawowych i rezerwowych);

b) ryzyko oszustw lub błędów wewnętrznych - związane z np. oszustwami księgowymi, różnego rodzaju kradzieżami dokonywanymi przez pracowników, wykorzystywaniem informacji poufnych, nadużyciami w zakresie wykonywania czynności formalnych w imieniu i na rachunek banku/firmy/organizacji;

c) ryzyko oszustw zewnętrznych - związane z np. przestępstwami komputerowymi, malwersacjami, kradzieżami (energii, informacji, innych wartości) na niekorzyść i na rachunek banku/firmy/organizacji;

d) ryzyko kadrowe - związane ze stosowaniem nieefektywnych mechanizmów rekrutacji, szkolenia, oceny i motywowania pracowników, powodujących nieadekwatność kadry do rodzaju i skali prowadzonej działalności lub niepożądaną jej fluktuację oraz brak identyfikacji z bankiem/firmą/organizacją;

e) ryzyko działalności operacyjnej - związane np. z niewłaściwym przygotowaniem nowych transakcji i umów, problemami klientów z informacjami i danymi, niewłaściwą obsługą klientów, nieprawidłowo ustalanymi limitami wewnętrznymi, błędami proceduralnymi (np. złe opracowanie kontraktu, niewłaściwe przednegocjacyjne prognozy cen);

f) ryzyko księgowe - związane np. z ewidencjonowaniem transakcji w sprzeczności z przyjętymi w banku/firmie/organizacji zasadami rachunkowości lub nieprawidłowym przeksięgowaniem (szczególnie wobec klientów handlowych);

g) ryzyko finansowe - związane rynkiem walut (w tym z rynkiem bilansującym) oraz z regulacjami zewnętrznymi (transakcje giełdowe, sprzedaż usług) oraz niepełną kompensacją kosztów;

h) ryzyko transakcyjne - związane np. z rodzajem lub wielkością transakcji (lekceważenie opcji odbiorcy), niewłaściwą dokumentacją, nieuzasadnioną kompensacją sprzedaży, błędną realizacją transakcji (np. niewłaściwe negocjowanie), brakiem optymalizacji systemowej w odniesieniu do portfolia kontraktów i transakcji giełdowych;

i) ryzyko prawne - związane np. z brakiem odpowiednich regulacji, błędnymi regulacjami wewnętrznymi, błędami prawnymi w zawieranych umowach, potencjalnymi zmianami w przepisach, brakiem stabilności otoczenia regulacyjnego, niekorzystnymi rozstrzygnięciami w procesach sądowych;

j) ryzyko funkcjonowania organizacji - związane np. z nieprzestrzeganiem zasad BHP, funkcjonowaniem związków zawodowych i organizacji pracowniczych, relacjami z klientami, akcjonariuszami i osobami trzecimi (np. skargi i pozwy sądowe, informacje prasowe), nieadekwatną informacją zarządczą, niewłaściwym planowaniem, przestarzałymi mechanizmami zarządzania, niedostosowaniem struktury organizacyjnej do skali działalności banku/firmy/organizacji;

k) ryzyko materialne i losowe - związane z np. utratą wartości majątku, terroryzmem, wandalizmem (fizyczne zniszczenie zasobów), kataklizmami;

l) ryzyko związane ze zlecaniem czynności na zewnątrz - związane z korzystaniem z usług podmiotów trzecich (outsourcing).

Odpowiednia identyfikacja i zarządzanie ryzykiem oraz adekwatne mechanizmy kontroli mogą nie tylko uchronić bank/firmę/organizację przed stratą, ale w efekcie - obniżyć koszty i zapewnić bardziej niezawodne bieżące działanie.

Świadomość wartości posiadanych aktywów w połączeniu z wiedzą o zagrożeniach i potencjalnych skutkach zmaterializowania się poszczególnych zagrożeń jest czynnikiem decydującym w procesach modyfikowania struktury banku/firmy/organizacji mających nie tylko zapewnić bezpieczeństwo informacyjne, ale zwiększyć bezpieczeństwo systemowe organizacji.

Jak to rozumieć, skoro mamy sytuację, w której na podstawie mniej lub bardziej trafnych ocen przyjętych dla incydentu czy też zakłócenia powinno się przyporządkować skutki ujawnionego zagrożenia, a w konsekwencji określić samo ryzyko oraz koszty jego materializacji (eliminacji lub maksymalnego ograniczenia wszelkich negatywnych skutków). Całość prac musi być bezwzględnie realizowana w myśl przepisów prawnych i technicznych, z zachowaniem wymogów ciągłości i poprawności działań.

Rzeczywista ocena występującego ryzyka jest zawsze bardzo trudna, nie ma bowiem dwu identycznych firm. Niemniej jednak stosuje się z powodzeniem grupy analiz zagadnień szczegółowych charakterystycznych dla poszczególnych systemów informacyjnych (bankowość, aeronautyka, medycyna, przemysł chemiczny i samochodowy itp.).

3.4. Kwalifikacja i kwantyfikacja ryzyk - rozwiązania programowane

W odniesieniu do systemów ICT (Information&Communication Technology), czyli informatycznych i telekomunikacyjnych powiązanych z sieciami i systemami rozległymi, opracowano zautomatyzowane systemy analizy ryzyka (głównie na potrzeby instytucji rządowych i dużych korporacji):

1. CRAMM (CCTA Risk Analysis & Management Methodology) - Wlk. Brytania, pakiet trzech części (identyfikacja i ocena podatności: 1-10 pkt; szacowanie ryzyka wg grup zagrożeń: 1-5 pkt; zbiór proponowanych/zalecanych rozwiązań - wg oceny pkt).

2. VIR'94 (Voorschrft Informatiebeyeiliging Rijkdienst)

- Holandia, pakiet z sześciu części, w tym metoda D&V (5i 3-etapowa analiza uzależnienia organizacji od ICT z jej podatnościami).

3. MARION - Wlk. Brytania, pakiet analizy kwalifikacyjno-kwantyfikacyjnej na potrzeby biznesu realizowany z wykorzystaniem znanych incydentów bezpieczeństwa w 27 kategoriach zasobów i zagrożeń (specjalizowany na podstawie prawa brytyjskiego).

4. MAGERIT (Methodology of Risk Analysisi&Management of Information Systems of Public Administration)

- Hiszpania, pakiet w trzech modułach i różnych proponowanych wersjach (C3) z odniesieniem do ICT w zakresie poziomu administracji użytkującej.

5. MASSIA (Methode d'Audit de la Securite des Systems d'Information de l'Armement) - Francja, pakiet wraz z oprogramowaniem narzędziowym dla sprawdzania SWB (szczególnych wymagań bezpieczeństwa) wg założeń ITSEC.

6. IST/RAMP (International Security Technology/Risk Analysis Management) - USA, program na sprzęt typu mainframe (komputery o dużej wydajności przetwarzania danych, których celem jest świadczenie usług dużej liczbie użytkowników) wykorzystujący metodologię kwantyfikacyjną dla systemów rozległych (pięć grup aktywów i odpowiadających im zagrożeń). Wyniki obrazowane są tabelarycznie na wydzielonym terminalu - PC jako stacja graficzna.

7. RISKPAC - USA, pakiet analizy kwalifikacyjno-kwantyfikacyjnej na potrzeby agencji rządowych (cztery kategorie instytucjonalne ICT, oddzielne zbiory aktywów i zagrożeń, możliwa korelacja wtórna i dodatkowa korekcja - oddzielny moduł zaleceń szczegółowych - wszystko na podstawie prawa amerykańskiego).

8. Pakiet BI/SAS+SAP - Polska, pakiet analizy ryzyka przemysłowego przedstawiony na SAS Forum 2005 jako wsparcie analityczne systemów ERP (baza zagrożeń jest rozwijana w trakcie wdrażania na podstawie badań ankietowych w firmie/baza aktywów ograniczona jest w swej treści do zawartości systemu ERP w firmie).

Obecnie system CRAMM posiada kolejne wersje dla średnich i małych przedsiębiorstw, ale należy pamiętać o każdorazowym sprawdzeniu ich aktualizacji prawnej, szczególnie w odniesieniu do ryzyk i możliwości dochodzenia praw poszkodowanego na drodze penalnej.

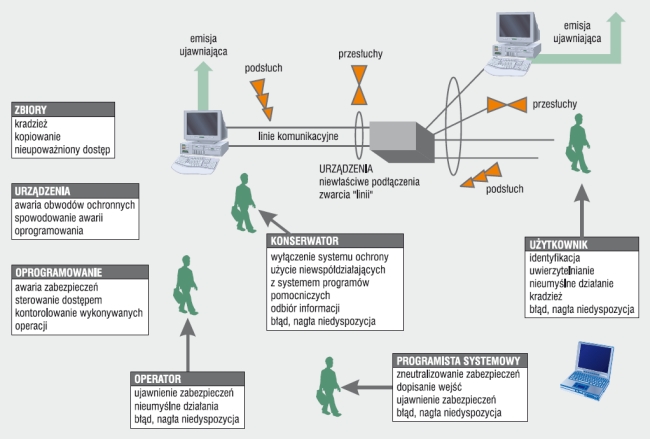

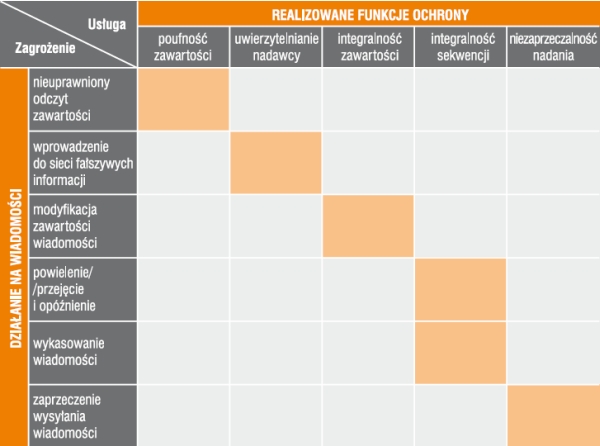

Schemat oddziaływań w systemach teleinformacyjnych (STI) na informację i jej atrybuty przedstawia rys. 6.

4. Systemy informacyjne i informatyczne

Ochrona informacji w przypadku systemu informacyjnego opartego w całości na technice informatycznej to przedsięwzięcia systemowe (programowo-sprzętowe). Do działań zabezpieczających zaliczyć tutaj należy12:

- stosowanie określonych bezpiecznych procedur przy projektowaniu i produkcji sprzętu teleinformatycznego,

- stosowanie określonych bezpiecznych procedur przy projektowaniu, kodowaniu, produkcji i dystrybucji oprogramowania,

- stosowanie odpowiednich programów operacyjnych (wewnętrzne narzędzia bezpieczeństwa programu, wprowadzanie praw dostępu, zabezpieczanie zbiorów i stanowisk pracy odpowiednimi hasłami lub narzędziami systemowymi),

- wykonywanie bezpiecznych instalacji sprzętowych („gorąca rezerwa", bezpieczeństwo zasilania, równoległość pracy, dodatkowe macierze itp.),

- stosowanie urządzeń i procedur do odtwarzania STI (backup, DRP itp.),

- kodowanie i szyfrowanie informacji jak i nośników z jej zbiorami.

Szczególnym elementem jest tutaj przewidywanie potencjalnych zagrożeń dla bezpieczeństwa systemu informacyjnego realizowanego przy wykorzystaniu projektowanego STI, co schematycznie przedstawia rys. 7:

Za główne należy jednak uznać działanie na korzyść ochrony wewnętrznych i zewnętrznych połączeń komunikacyjnych STI. Systemy teleinformatyczne charakteryzują się bowiem pod względem swego wykorzystania w procesach informacyjnych dwoma elementarnymi procesami:

- przetwarzaniem informacji w samym systemie,

- przesyłaniem informacji między systemami, co wiąże się z odpowiednimi funkcjami obsługi i usługami systemowymi, a zarazem wymaga odpowiednich uprawnień w zakresie dostępu i czynności wobec zbiorów/zasobów informacyjnych, bo nawet wiadomości przekazywane w obrębie firmy są narażone na rozmaite niepożądane oddziaływania, stąd konieczne są funkcje ochrony dla systemu ich przemieszczania (od adresata do odbiorcy - z nie zbędną wiarygodnością działań).

Należy przy tym pamiętać, że w przypadku systemów teleinformatycznych można stosunkowo łatwo spełniać łącznie wymogi poszczególnych kryteriów, ale istotna staje się wówczas dostępność nie tyle informacji, ile aktywów całego systemu.

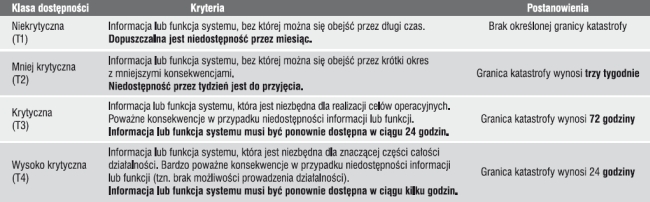

Brak dostępu do istotnych informacji może zagrozić katastrofą, w rozumieniu niemożliwości realizacji planowanych lub oczekiwanych działań biznesowych. Z tego też tytułu dostępność aktywów technologii informatycznej jest na ogół klasyfikowana do jednej z wymienionych poniżej czterech klas bezpieczeństwa: T1 - T4.

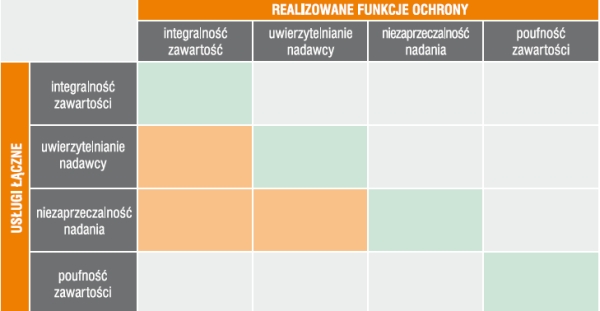

Działaniem pochodnym jest przyjęcie jednakowych narzędzi zapewniających: uwierzytelnienie nadawcy, integralność przesyłki, niezaprzeczalność nadania i odbioru, poufność przesyłki, bezpieczeństwo transmisji oraz dostępność systemu i informacji w nim (tab. 1).

Należy mieć świadomość tego, że przytoczone powyżej opisy działań systemowo-technicznych są przykładowe, a nad ciągłością działania i prawidłowym przebiegiem procesów komunikacyjnych czuwają osoby funkcyjne o odpowiednich uprawnieniach i wyposażone w niezbędne narzędzia systemowe.

5. Wybór dobrej idei

W wyniku przeprowadzonych kolejnych etapów analizy funkcjonalnej (zob. AF - cz. I) problemy ochrony informacji wobec idealistycznego kryterium, jakim jest wybór rozwiązania ze względu na ustalone cele końcowe. W odniesieniu do reguł biznesowych (cięcie kosztów - maksymalizacja zysków) nagminne są sytuacje, kiedy to menedżer, mówiąc o ochronie informacji, wcale nie chce jej ulepszać czy poprawiać - chce zaoszczędzić na wydatkach na ochronę i bezpieczeństwo informacji.

Panowie prezesi i menedżerowie głównych procesów w licznych instytucjach po prostu zapominają, że bezpieczeństwo informacji nie jest stanem - ono jest procesem o fluktuacjach bardzo trudnych chwilami do przewidzenia. Wszystko jest zależne od przyjętych w danej firmie kryteriów oceny wartości dla systemu informacyjnego i objętych jego działaniami zasobów.

6. Chwila refleksji...

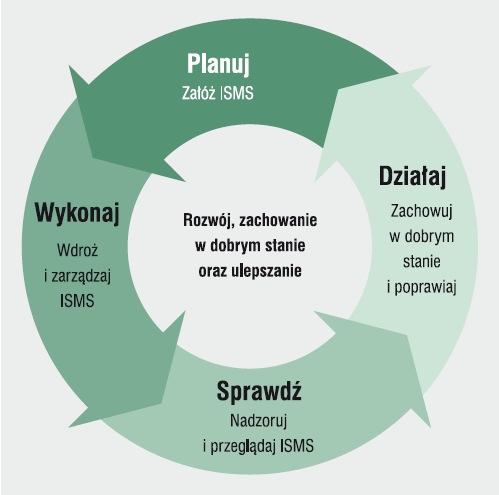

Normy bezpieczeństwa opierają się na zasadach ogólnych zarządzania jakością (ISO 9001) oraz na cyklu Deminga (PDCA - Plan-Do-Check-Act), co widać również w odniesieniu do ISMS na rys. 10.

Ale decydujące dla całości teoretycznych i praktycznych działań w ochronie informacji jest przestrzeganie kilku podstawowych założeń:

1. Ochrona STI musi być prowadzona jako proaktywna, istotne jest użytkowanie systemu, a nie jego naprawianie i ściganie winnych - choć i tego nie wolno zaniedbać.

2. Tylko świadomość wszystkich zaangażowanych osób (zarządzających, użytkowników, eksploatatorów, projektantów oraz pionów ochrony bezpieczeństwa informacji na każdym z etapów) pozwoli na wykrycie i wyeliminowanie krytycznych incydentów, zanim staną się one kłopotliwymi zdarzeniami (oby nie katastrofami).

3. Trzeba planować koszty zachowania oraz ciągłość inwestowania w realizowanych/przyszłych procesach ochrony i bezpieczeństwa informacji.

O czym, po raz kolejny, pozwalam sobie przypomnieć wszystkim zainteresowanym...

dr inż. Marek Blim

Bibliografia

1. Normy

- PN-ISO/IEC 17799:2007 Bezpieczeństwo informacji. Systemy zarządzania bezpieczeństwem informacji. Praktyczne zasady zarządzania bezpieczeństwem informacji

- PN-ISO/IEC 27001:2007 Bezpieczeństwo informacji. Systemy zarządzania bezpieczeństwem informacji. Specyfikacja i wytyczne do stosowania

2. Anderson R.: Inżynieria zabezpieczeń, seria TAO, WNT, Warszawa, 2005.

3. Anonim (Sams): Internet - agresja i ochrona, Robomatic, Warszawa, 2003.

4. Beynon-Davies P.: Inżynieria systemów informacyjnych, WNT, Warszawa, 2002.

5. Białas A.: Bezpieczeństwo informacji i usług w nowoczesnej instytucji i firmie, WNT, Warszawa, 2006.

6. Białas A.: Podstawy bezpieczeństwa systemów teleinformatycznych, wyd. Jacka Skalmierskiego, Gliwice, 2002.

7. Blim M.: Zarządzanie bezpieczeństwem obiektu, skrypt kursu instalatorów SA-4, Techom, Warszawa, 2004.

8. Blim M.: Zarządzanie jakością i bezpieczeństwem systemów TI, materiały szkoleniowe IOP PW, Warszawa, 2004.

9. Byczkowski M., Blim M., J. Zawiła-Niedźwiecki: Zarządzanie ryzykiem operacyjnym w świetle wymogów Komitetu Bazylejskiego, T. V, materiały konferencyjne XVI Szkoły Górskiej PTI, Szczyrk, 2004.

10. Dolińska I.: Sieci komputerowe, WSE-I, Warszawa, 2005.

11. Frankowski P.: Komputerowi detektywi. 111 porad, Mikom, Warszawa, 2003.

12. Gałach A.: Instrukcja zarządzania bezpieczeństwem systemu informatycznego, ODDK, Gdańsk, 2004.

13. Kaczor P.: Hacking, cracking, phreacking, czyli ochrona przed cyberoszustami, MIKOM, Warszawa, 2004.

14. Konieczny J.: Wprowadzenie do bezpieczeństwa biznesu, Konsalnet SA, Warszawa.

15. Krupa T.: Wybrane aspekty zarządzania wiedzą w przedsiębiorstwach UE, Oficyna Wydawnicza Polskiego Towarzystwa Zarządzania Produkcją, Opole, 2006.

16. Lam K., LeBlanc, Smith B.: Ocena bezpieczeństwa sieciowego, APN Promise, Warszawa, 2005.

17. Liderman K.: Standardy w ocenie bezpieczeństwa teleinformatycznego, Biuletyn IAiR Nr 17, WAT, Warszawa, 2000.

18. Liderman K.: Bezpieczeństwo teleinformatyczne, wydanie 1, IAiR WAT, Warszawa, 2001.

19. Lukatsky A.: Wykrywanie włamań i aktywna ochrona danych. Elita rosyjskich hakerów prezentuje îO .IÇIÄÉ!, Helion, Gliwice, 2003.

20. Mandia K., Proise C.: Hakerom śmierć!, RM, Warszawa, 2002.

21. McNamara: Arkana szpiegostwa komputerowego, Helion, Gliwice, 2001.

22. Pipkin D. L.: Bezpieczeństwo informacji. Ochrona globalnego przedsiębiorstwa, seria TAO, WNT, Warszawa, 2002.

23. Bezpieczeństwo od A do Z, wydanie 17, Wiedza i Praktyka, Warszawa, styczeń 2004.

24. Informatyka. Terminologia znormalizowana i wykaz norm, praca zbiorowa, PKN, Warszawa, 2006.

Zabezpieczenia 4/2007